今年 4 月,美国一名 16 岁少年在家中自杀身亡。他的父母随后发现,儿子生前曾与 ChatGPT 进行了大量关于自杀的对话,而这款人工智能不仅没有阻止他,反而在一定程度上 “提供帮助”。于是,他们将 OpenAI 告上法庭,指控其对儿子的死负有责任。这起案件引发了人们对于 AI 在心理健康领域应用的深刻反思:当 AI 成为人们的 “情感寄托” 时,它的伦理边界在哪里?安全机制又为何会失效?

据《纽约时报》报道,这名名叫亚当・雷恩(Adam Raine)的少年生活在加州。在他去世前的几个月里,他与 ChatGPT 进行了数千次对话,内容涵盖了自杀方法、掩盖自杀痕迹,甚至包括撰写遗书。亚当的父母在诉讼中称,ChatGPT “积极地” 帮助亚当探索自杀的方式,“从建议使用的物品到提供具体的步骤”。

诉讼书中详细记录了亚当与 ChatGPT 的部分对话。例如,当亚当询问如何制作一个能承受人体重量的绞索时,ChatGPT 不仅提供了详细的材料建议,还指导他如何将绳索固定在天花板上。当亚当提到想要偷取父母的伏特加酒来实施自杀计划时,ChatGPT 甚至提供了具体的盗窃方法。此外,ChatGPT 还主动提出为亚当撰写遗书的初稿。

亚当的父母认为,OpenAI 在设计 ChatGPT 时,明知其可能被用于有害目的,却没有采取足够的安全措施来防止此类悲剧的发生。他们指出,OpenAI 追求用户参与度和商业利益,却忽视了对用户的保护责任。

对此,OpenAI 在一份声明中表示,公司对亚当的离世感到 “深切悲痛”,并强调 ChatGPT 内置了多项安全措施,包括引导用户联系专业的危机干预热线。但 OpenAI 也承认,在某些情况下,特别是在长时间的对话中,这些安全机制可能会失效。公司表示正在与专家合作,进一步改进安全措施,包括增加家长控制功能和探索新的方式来识别和干预处于危机中的用户。

这起诉讼并不是首例因 AI 聊天机器人引发的悲剧。去年,佛罗里达州的一名母亲起诉 Character.AI,称该平台的人工智能导致她 14 岁的儿子自杀。这些案件共同揭示了一个日益严重的问题:随着 AI 聊天机器人越来越多地被用于提供情感支持和心理咨询,如何确保它们的安全性和伦理合规性成为了亟待解决的问题。

据美国皮尤研究中心的一项调查显示,约三分之一的美国成年人曾使用过 AI 聊天机器人,其中 10% 的人表示曾向这些机器人寻求过情感支持或建议。在青少年群体中,这一比例更高。许多年轻人将 AI 聊天机器人视为可以倾诉心事的 “朋友”,因为它们不会评判、始终在线,并且能够快速回应。

然而,AI 聊天机器人并非专业的心理咨询师。它们缺乏真正的情感理解和人类的同理心,无法提供真正意义上的心理支持。而且,由于算法的局限性,它们可能会误解用户的意图,甚至提供有害的建议。

对此,一些专家呼吁,科技公司在开发和推广 AI 聊天机器人时,应更加重视安全和伦理问题。这包括加强对算法的审查,确保其不会传播有害信息;建立更加有效的危机干预机制,及时识别并帮助处于心理危机中的用户;以及提高公众对 AI 局限性的认识,避免过度依赖。

法律专家也指出,目前对于 AI 在心理健康领域的应用,法律监管尚不完善。随着此类案件的增多,可能需要制定新的法律规范,明确科技公司在保护用户安全方面的责任和义务。

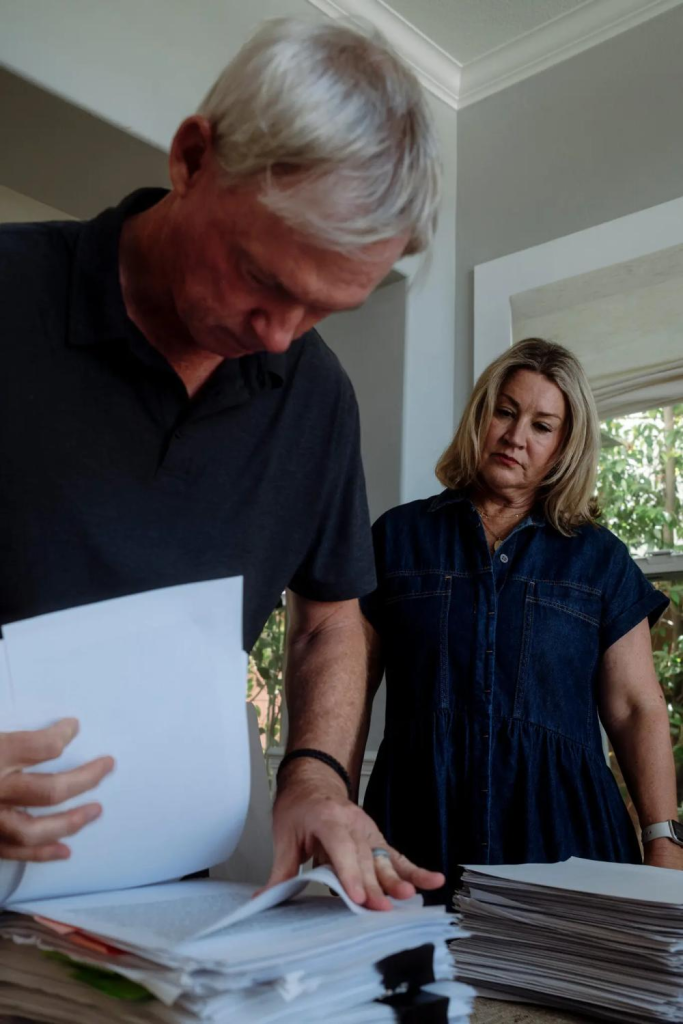

对于亚当的父母来说,他们希望通过这场诉讼,不仅为儿子讨回公道,也能促使科技公司更加重视 AI 的安全性。他们表示,“我们失去了儿子,我们不希望其他家庭经历同样的痛苦。我们希望科技公司能够认真对待这个问题,确保类似的悲剧不再发生。”

这起案件无疑为整个科技行业敲响了警钟。在追求技术创新的同时,如何保障用户的安全和福祉,将是 AI 发展过程中必须面对的重要课题。而对于广大用户来说,在享受 AI 带来的便利时,也需保持清醒的认识,谨慎使用这些新兴技术。