一、反直觉的警示:越智能的系统,越让人紧张?

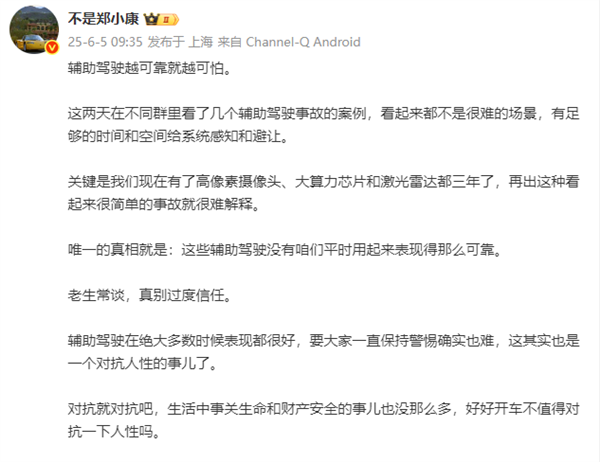

汽车博主”不是郑小康”日前在微博抛出一个颠覆认知的观点:”辅助驾驶越可靠,反而越可怕。” 这一言论迅速引发热议,点赞量突破5万。

现象与本质的背离

- 技术进步的悖论:

当前辅助驾驶系统已配备高像素摄像头(如特斯拉HW4.0的500万像素)、大算力芯片(英伟达Orin X算力254TOPS)和激光雷达(蔚来ET7搭载图达通猎鹰),理论上应大幅降低事故率。- 现实矛盾:2025年Q1数据显示,L2级辅助驾驶相关事故同比仅下降2%,远低于技术迭代速度。

- 人机信任危机:

博主指出:”系统表现越好,驾驶员越容易分心。当一次紧急制动成功后,下一次松懈可能就是致命的。”

典型案例复盘

- ”幽灵刹车”争议:

某品牌车型在高速上误识别锥形桶为障碍物,急刹导致后车追尾。车主吐槽:”系统太敏感,不如自己判断。” - ”接管请求延迟”:

测试中理想L9在弯道突然要求接管,驾驶员因反应不及险些撞上护栏。工程师承认:”算法对复杂路况的预测仍有盲区。”

二、心理博弈:完美系统为何引发焦虑?

1. 控制感的丧失

- 人类本能:驾驶是高度依赖即时决策的行为,当系统表现”过于完美”时,驾驶员会潜意识质疑其可靠性。

- 实验数据:麻省理工学院研究显示,使用辅助驾驶时,驾驶员瞳孔放大率比手动驾驶高40%,表明潜意识处于紧张状态。

2. 责任界的模糊地带

- 法律困境:

现行法规对”驾驶员是否需全程监控”尚无明确规定,导致事故责任认定困难。- 案例:2024年某事故中,特斯拉车主因过度依赖Autopilot被判定负全责,尽管系统确实出现误判。

- 心理负担:

“就像背着降落伞飞行,你知道它可能在关键时刻救你,但也担心它会不会突然失效。”一位车主如此比喻。

3. 技术依赖的恶性循环

- 能力退化:长期使用辅助驾驶会导致驾驶员反应速度下降,研究显示平均制动反应时间延长0.3秒(相当于时速100km时多行驶8.3米)。

- 系统依赖症:部分用户已出现”无辅助不敢上路”的症状,形成新的技术焦虑。

三、行业反思:如何平衡创新与安全?

1. 技术层面的改进方向

- 冗余设计:

蔚来正在测试”双系统互为备份”方案,当主系统失效时,备用系统可在100毫秒内接管。 - 透明度提升:

小鹏汽车推出”驾驶决策可视化”功能,让驾驶员实时看到系统判断依据(如障碍物距离、车速建议)。

2. 用户教育的革新

- ”渐进式信任”培养:

特斯拉更新用户手册,明确要求驾驶员每15分钟必须手动接管一次,即使系统运行正常。 - 风险情景模拟:

宝马开发VR训练程序,让车主体验辅助驾驶失效时的正确应对方式。

3. 法规与伦理的突破

- 动态责任认定:

欧盟新规提议根据系统介入程度划分责任比例(如系统控制90%时,车企担责90%)。 - ”冷静期”设计:

通用汽车申请专利,在检测到驾驶员过度依赖时,自动降低辅助等级以强制其重新接管。

四、未来展望:人机共驾的终极平衡点

博主的警示本质上揭示了一个深层矛盾:当技术无限逼近人类驾驶水平时,反而会暴露人机协作的脆弱性。

理想状态的三大特征

- 可解释性:

系统能清晰告知决策逻辑(如”因检测到左后方车辆变道轨迹异常,建议减速”)。 - 弹性边界:

允许驾驶员适度”偷懒”,但在关键时刻强制接管(参考航空业的”飞行员监控系统”)。 - 共同进化:

通过持续学习驾驶员习惯优化策略(如识别某用户偏好激进变道风格)。

专家预言

中国工程院院士李骏指出:”未来5-10年,辅助驾驶将进入’可信区间’——既不过度干预引发厌烦,也不完全放手导致危险。这需要技术、法规和人性三者的精密校准。”

五、给车主的实用建议

- ”5秒法则”:

每隔5秒用余光扫视路况,避免完全依赖屏幕信息。 - ”场景清单”:

提前列出容易触发误判的场景(如隧道入口、强逆光),提前准备接管。 - ”压力测试”:

定期手动驾驶复杂路段(如连续弯道),保持驾驶技能不退化。

正如博主所言:”别把命交给任何系统——哪怕它看起来聪明绝顶。”在智能汽车时代,保持敬畏或许是最好的安全策略。

(本文数据来源:MIT自动驾驶实验室、J.D.Power用户调研、欧盟新规草案)